Apa itu ANOVA?

ANOVA adalah teknik statistik yang digunakan untuk membandingkan

rata-rata dari tiga atau lebih kelompok. Tujuan utamanya adalah untuk

menentukan apakah ada perbedaan yang signifikan di antara rata-rata kelompok

tersebut. Misalnya, jika kita ingin mengetahui apakah tiga jenis pupuk yang

berbeda memiliki efek yang berbeda terhadap pertumbuhan tanaman, ANOVA dapat

membantu kita menguji hal tersebut.

Konsep Dasar ANOVA

- Variabilitas

Antar Kelompok (Between-Group Variability): Ini adalah

variasi yang disebabkan oleh perbedaan antara kelompok. Misalnya, variasi

yang dihasilkan dari penggunaan tiga jenis pupuk yang berbeda.

- Variabilitas

Dalam Kelompok (Within-Group Variability): Ini adalah

variasi yang disebabkan oleh perbedaan di dalam kelompok yang sama.

Misalnya, variasi pertumbuhan tanaman dalam kelompok yang menggunakan

pupuk yang sama.

ANOVA membandingkan kedua jenis variabilitas ini untuk menentukan apakah perbedaan antar kelompok lebih besar dari variabilitas dalam kelompok. Jika variabilitas antar kelompok jauh lebih besar, maka kita mungkin menyimpulkan bahwa ada perbedaan signifikan antara kelompok.

Asumsi-Asumsi

ANOVA

Agar hasil ANOVA valid, ada beberapa asumsi yang

harus dipenuhi:

- Independensi: Observasi dalam setiap kelompok harus independen. Artinya, nilai

dalam satu kelompok tidak boleh mempengaruhi nilai dalam kelompok lain.

- Normalitas: Data dalam setiap kelompok harus mengikuti distribusi normal. Ini terutama

penting jika ukuran sampel kecil.

- Homoskedastisitas: Varians antar

kelompok harus homogen, yang berarti bahwa variabilitas dalam setiap

kelompok harus kira-kira sama.

Langkah-langkah dalam ANOVA

- Hipotesis: Ho dan Ha (atau H1).

- Menghitung Rata-Rata untuk Setiap Kelompok

- Menghitung Rata-Rata Keseluruhan

- Menghitung Sum of Squares Between (SSB)

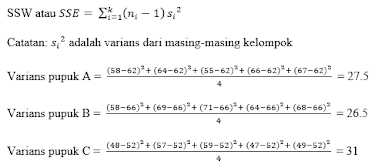

- Menghitung Sum of Squares Within (SSW)

- Menghitung Mean Square Between (MSB)

- Menghitung Mean Square Within (MSW)

- Menghitung F-Statistik

- Membandingkan dengan Nilai Kritis

- Kesimpulan

Interpretasi Hasil ANOVA

- F-Statistik: Jika nilai F

yang dihitung lebih besar dari nilai kritis, kita menolak hipotesis nol

dan menyimpulkan bahwa ada perbedaan yang signifikan antara kelompok.

- P-Value: Ini adalah

probabilitas bahwa hasil yang kita peroleh dapat terjadi secara kebetulan.

P-value yang kecil (biasanya < 0,05) menunjukkan bahwa ada perbedaan

signifikan antara kelompok.

Contoh Sederhana

Misalkan kita menguji tiga jenis pupuk (A, B, dan C) dan kita memiliki

data tinggi tanaman dari tiga kelompok ini. ANOVA akan membantu kita menentukan

apakah perbedaan tinggi tanaman antara ketiga kelompok ini cukup signifikan

atau hanya disebabkan oleh variasi acak dalam data.

Dengan mengikuti langkah-langkah di atas dan memenuhi asumsi-asumsi

ANOVA, kita dapat menyimpulkan apakah jenis pupuk mempengaruhi pertumbuhan

tanaman secara signifikan atau tidak.

Berikut adalah tabel yang berisi data sampel tinggi tanaman untuk tiga

jenis pupuk: A, B, dan C.

|

Pupuk A |

Pupuk B |

Pupuk C |

|

58 |

58 |

48 |

|

64 |

69 |

57 |

|

55 |

71 |

59 |

|

66 |

64 |

47 |

|

67 |

68 |

49 |

Langkah-langkah dalam ANOVA

H0: Tidak ada perbedaan rata-rata tinggi tanaman di antara ketiga jenis

pupuk.

Ha: Ada setidaknya satu perbedaan rata-rata tinggi tanaman di antara

ketiga jenis pupuk.

atau,

H0: μA = μB = μC

Ha: Tidak semua

populasi memiliki rerata yang sama

3. Menghitung Rata-Rata Keseluruhan

k adalah banyaknya kelompok = 3

9. Membandingkan dengan Nilai Kritis

- α = 0.05

- degree of freedom 1 atau df1 atau df pembilang = k – 1 = 3 - 1 = 2

- degree of freedom 2 atau df2 atau df penyebut = nT - k = 15 - 3 = 12

- Cek menggunakan tabel F

- Tabel F dengan α = 0.05, df1 = 2, df2 = 12 adalah 3.89

Dengan Demikian F >

Fα atau jika menggunakan p-value maka p-value < α

10. Kesimpulan

Karena F ≥ Fα (9.18 > 3.89) atau p-value ≤ α maka Ho ditolak

Penutup

ANOVA adalah alat yang sangat berguna dalam

statistik untuk membandingkan rata-rata dari tiga atau lebih kelompok. Dengan

memahami dan memenuhi asumsi-asumsi dasar serta mengikuti langkah-langkah yang

tepat, kita dapat menggunakan ANOVA untuk menarik kesimpulan yang valid tentang

perbedaan antara kelompok.

Semoga penjelasan ini membantu memahami ANOVA dengan cara yang sederhana dan mudah dipahami!

Comments

Post a Comment